時間的順序の判決のモデルベース分析により注目し、視覚処理速度を測定します

Summary

Temporal-order judgments can be used to estimate processing speed parameters and attentional weights and thereby to infer the mechanisms of attentional processing. This methodology can be applied to a wide range of visual stimuli and works with many attention manipulations.

Abstract

このプロトコルは、視覚処理速度と注意資源の分布を測定するための時間的順序の実験を行う方法について説明します。時間的順序判断(TOJ)パラダイム、視覚的注意のBundesenの理論(TVA)、および階層ベイズ推定の枠組み:提案された方法は、3つのコンポーネントの新しいと相乗的な組み合わせに基づいています。この方法は、TVAの理論的および神経生理学的基盤によってサポートされて容易に解釈可能なパラメータを、提供します。 TVAで使用される伝統的なパラダイムは、主に文字と数字に限定されているのに対し、TOJsを使用して、TVAベースの推定値は、刺激の広い範囲のために取得することができます。最後に、提案したモデルの意味のあるパラメータは、階層ベイズモデルの確立を可能にします。このような統計モデルは、1コヒーレントテーマに関する分析の両方とグループレベルで結果を評価することができます。

実現可能性とvを実証するために、この新しいアプローチのersatility、3つの実験は、合成飛び出し表示され、自然画像の注目操作で報告され、手掛かり手紙レポートパラダイムされています。

Introduction

注意が空間と時間に配布されてどのように人間の視覚の中で最も重要な要素の1つです。なぜなら彼らの誘目または重要で注目を集めるオブジェクトは通常より速く処理され、より精度の高いされています。行動研究では、このような性能上の利点は、実験パラダイムの様々な実証されています。例えば、ターゲットの場所に注意を割り当てることプローブ検出タスク1での反応をスピードアップします。同様に、文字の報告の精度が注目2によって改善されます。このような所見は注意が処理を増強することを証明するが、彼らはこの拡張が確立された方法については絶望的にミュートのまま。

本稿では、注目の利点の背後にある低レベルのメカニズムがきめ細かいするcomponenを測定に関するモデルベースの枠組みの中で個々の刺激の処理速度を測定することによって評価することができることを示しています注目のTS。このようなモデルを用いて、刺激間の全体的な処理能力とその分布は、処理速度測定値から推測することができます。

視覚的注意のBundesenの理論(TVA)3は、この試みに適したモデルを提供します。それは、典型的には、文字レポートタスクからのデータに適用されます。以下では、TVAの原理を説明すると、(ほとんど)任意の刺激を用いて得られた時間的な順序を判定(TOJ)データをモデル化するために拡張することができる方法を示しています。この新規な方法は、容易に解釈可能な処理速度やリソース配分の推定値を提供します。この記事のプロトコルは、そのような実験を計画し、実施する方法を説明し、データを分析することができる方法を詳しく説明します。

前述したように、TVAベースのモデリングと注意パラメータの推定における通常のパラダイムは、文字のレポートタスクです。参加者は、一連の文字のIDを報告します簡単にフラッシュし、一般的に様々な遅延の後にマスクされています。他のパラメータの中でも、視覚的な要素は視覚短期記憶に符号化される速度を推定することができます。メソッドが正常に基礎・臨床研究の質問に適用されています。例えば、Bublakや同僚4は注意パラメータは加齢に関連する認知障害の異なる段階で影響を受けるかを評価しました。基本注目研究において、ピーターセン、Kyllingsbæk、及びBundesen 5は 、一定の時間間隔で二つの標的の第二の知覚における観察者の困難を注意滞留時間の効果をモデル化するためにTVAを用います。手紙レポートパラダイムの主な欠点は、それが十分にoverlearnedマスカブル刺激を必要とすることです。この要件は、文字と数字にメソッドを制限します。他の刺激は、参加者の重いトレーニングを必要とするであろう。

TOJパラダイムは、特定のstimulも必要としません私もマスキング。これは、出現順序を判断することができるために、刺激の任意の種類で使用することができます。これは、直接クロスモーダル比較6を含む関心の可能性がほとんどすべてに刺激範囲を拡張します。

TOJsと注意を調査することはかなり早い時期に出席した刺激が無人の1に比べて認識されているかの尺度である注意前のエントリの現象に基づいています。残念ながら、(例えば累積ガウスまたはロジスティック関数など)観察性能心理関数をフィッティングTOJデータを解析するための通常の方法は、注意が参加し、刺激の処理速度を増加させるか、無人の刺激7の速度を減少する場合かどうかを区別することができません。この曖昧さは、刺激の知覚は本当に強化されているかどうかのための質問の主要な問題であるか、それがために、競合stimulからのリソースの撤退の利点場合私たちは、両方の基本的かつ実用的な関連性の問題です。例えば、ヒューマン・マシン・インターフェースの設計のためには、一つの要素の隆起の増加は別の犠牲に動作するかどうかを知るために非常に適切です。

次のようにTOJタスクは通常進行する:固定マークは一般的に、短い遅延のために提示ランダム秒より短い間隔描かれています。そして、第1の目標が提示され、第二の標的によって可変刺激開始の非同期(SOA)の後に続きます。負のSOAでは、 プローブ 、出席した刺激は、最初に示されています。正のSOAでは、 参照 、無人の刺激は、リード。ゼロのSOAでは、両方のターゲットが同時に示されています。

一般的に、目標を提示することに刺激を切り替えることをいいます。特定の条件下では、しかし、そのような既に存在する標的またはオフセットのちらつきなどの他の一時的なイベントは、8に使用されます。

_content "("最初の正方形の最初の"と別の1"ダイヤモンド> TOJsでは、応答は通常、刺激アイデンティティとプレゼンテーションの注文にマッピングされたキーによって、unspeeded方法で採取されたが、刺激が正方形と菱形である場合、例えば 、一つのキーを示し") 。重要なことは、評価のために、これらの判断は、「最初のプローブ」に変換されなければならない(または「参照最初の ")の判断。本研究では、TVAとTOJ実験パラダイムの処理モデルの組み合わせは、個々のドメイン内の問題点を解消するために使用されます。この方法では、容易に解釈可能な速度パラメータは、観察者の注意は視覚要素競合に割り当てられているかを推測することを可能にする、ほとんど任意の視覚刺激のために推定することができます。

モデルは、まもなく以下に説明する個々の刺激を処理するためのTVAの方程式に基づいています。確率は1 stimul他が最初に現れるように、この刺激を判断する確率として解釈される前に、私たちは視覚的短期記憶に符号化されます。個々の符号化期間が指数関数的に9配布されます。

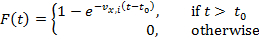

(1)

(1)

最大効果のない露光持続時間t 0は何もすべてでエンコードされていない前に、閾値です。 TVA、速度v xに応じて、私はこれに物体xが(例えば、色や形状など)知覚カテゴリーIのメンバーとして符号化され、 レート方程式で与えられます。

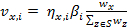

。 (2)

。 (2)

xは、iはiは、ηxに発現しており、 私は 、カテゴリIのメンバーとして刺激を分類するための意思決定バイアスであるβれるカテゴリに属していることを感覚的証拠の強さ。これは、乗算されますttentional重み。 Xワット個々の注意重みは視野内のすべてのオブジェクトの注意の重みによって分割されています。したがって、相対的な注意重量は次のように計算され

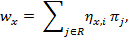

(3)

(3)

Rは、すべてのカテゴリとηxを表し、私は、オブジェクトxはカテゴリjに属することを感覚的な証拠を示しています。値πjは 、カテゴリjの妥当性と呼ばれるとjに分類を行うためのバイアスを反映しています。全体の処理容量Cは、すべての刺激と分類のためのすべての処理速度の合計です。 TVAの詳細については、BundesenとHabekostの本9を参照してください。

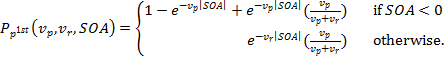

個々の刺激の符号化を説明我々の新規な方法、式(1)において、TOJsのモデルに変換されます。選択バイアスおよびレポートカテゴリががconstanあると仮定すると、Pワット実験タスク内で、処理速度のV pとV 2つのターゲットの刺激プローブ(p)のrと参照(r)は、CとフォームのV P = Cでの注意の重みに依存トン・とv R = C・それぞれR、ワット新しいTOJモデルは、参加者がSOAと処理速度の関数として最初になるようにプローブの刺激を判断することが、成功の確率P pが第一を表します。これは次のように定式化することができます。

(4)

(4)

この方程式は、基本的なTVA方程式から導出される方法のより詳細な説明はTünnermann、ピーターセン、及びScharlau社7に記載されています。

簡略化のために、パラメータt 0は 、元TVAによると、式1のモデルでは省略され、時刻t 0が boのために同一である必要がありますしたがって、それは番目のTOJタスクでターゲットとし、相殺します。しかし、この仮定は時々(セクションの説明を参照)に違反することができます。

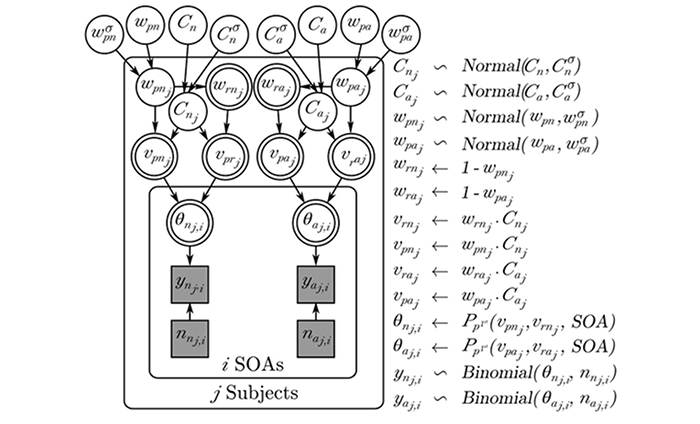

TOJデータにこの式をフィッティングするために、階層ベイズ推定方式11が提案されています。このアプローチは、pとプローブと基準刺激のW rと全体の処理速度C.これらのパラメータは、得られる吸収速度V pおよびV rを、それらの間に注意誘導性の差W注意重みを推定することができ、評価することができます推定の不確実性とともに、被写体とグループレベルで。階層モデルは実験の計画段階で、図1に示されている、便利なベイジアン電力解析を行うことができます。

以下のプロトコルは、TOJ実験を実行し、分析し、計画する方法について説明しているから、視覚刺激のための処理速度パラメータと注意ウエイトことができます得られます。プロトコルは、研究者が注意操作が興味のあるいくつかのターゲットの処理速度にどのように影響するかに関心があることを前提としています。

図1:ベイズ推定手順で使用されるグラフィカルモデル。円は推定分布を示しています。二重丸は、確定ノードを示しています。四角はデータを示しています。関係は図の右側に示されています。丸いフレーム(「プレート」)外のノードは、グループレベルで(概要を参照してください)TVAパラメータの平均と分散の推定値を表します。 「J科目」板では、それがどのように注意の量(ワット)見ることができ、被写体のレベルで刺激処理速度(V)からに、全体的な処理速度(C)と組み合わされます。プレート「私のSOA”これらのTVAパラメータは、各SOAでの二項分布する応答の成功確率(θ)へ(はじめに説明関数P pが第一を介して)変換される方法を示しています。したがって、SOAの繰り返しと共にθ(n)は、データ点(y)を説明します。表記法とグラフィカルモデルの解釈の詳細については、リーとWagenmakers 23を参照してください。明瞭にするため、パラメータの差を表すノードが省略されていることに留意されたいです。これらの決定論的パラメータは、代わりに、実験結果の図に示されています。 この図の拡大版をご覧になるにはこちらをクリックしてください。

Protocol

Representative Results

Discussion

この記事のプロトコルは、単純なTOJsを実施し、基本刺激エンコーディングに基づいてモデルをデータにフィットする方法について説明します。 3つの実験の結果は非常に異なった刺激材料における注目の影響を評価するために、階層的ベイズ推定の枠組みの中で評価することができる方法を実証しました。ポップアウトディスプレイの顕著性が向上注意重みにつながりました。また、増加し?…

Divulgazioni

The authors have nothing to disclose.

Acknowledgements

Parts of this work have been supported by the German Research Foundation (DFG) via grants 1515/1-2 and 1515/6-1 to Ingrid Scharlau.

Materials

| Personal Computer |

| (Open Source) Experimentation and evaluation software |

Riferimenti

- Posner, M. I. Orienting of attention. Quarterly Journal of Experimental Psychology. 32 (1), 3-25 (1980).

- Van der Heijden, A., Wolters, G., Groep, J., Hagenaar, R. Single-letter recognition accuracy benefits from advance cuing of location. Perception & Psychophysics. 42 (5), 503-509 (1987).

- Bundesen, C. A theory of visual attention. Psychological Review. 97 (4), 523-547 (1990).

- Bublak, P., et al. Staged decline of visual processing capacity in mild cognitive impairment and Alzheimer’s disease. Neurobiology of Aging. 32 (7), 1219-1230 (2011).

- Petersen, A., Kyllingsbæk, S., Bundesen, C. Measuring and modeling attentional dwell time. Psychonomic Bulletin & Review. 19 (6), 1029-1046 (2012).

- Vroomen, J., Keetels, M. Perception of intersensory synchrony: A tutorial review. Attention, Perception, & Psychophysics. 72 (4), 871-884 (2010).

- Tünnermann, J., Petersen, A., Scharlau, I. Does attention speed up processing? Decreases and increases of processing rates in visual prior entry. Journal of Vision. 15 (3), 1-27 (2015).

- Krüger, A., Tünnermann, J., Scharlau, I. Fast and conspicuous? Quantifying salience with the Theory of Visual Attention. Advances in Cognitive Psychology. 12 (1), 20 (2016).

- Bundesen, C., Habekost, T. . Principles of Visual Attention: Linking Mind and Brain. , (2008).

- Plummer, M. JAGS: A program for analysis of Bayesian graphical models using Gibbs sampling. Proceedings of the 3rd international workshop on distributed statistical computing. , 124-125 (2003).

- Kruschke, J. K., Vanpaemel, W., Busemeyer, J., Townsend, J., Wang, Z. J., Eidels, A. Bayesian estimation in hierarchical models. The Oxford Handbook of Computational and Mathematical Psychology. , 279-299 (2015).

- Mathôt, S., Schreij, D., Theeuwes, J. OpenSesame: An open-source, graphical experiment builder for the social sciences. Behavior Research Methods. 44 (2), 314-324 (2012).

- Kruschke, J. K. . Doing Bayesian data analysis: A tutorial with R, JAGS, and Stan. , (2015).

- Rensink, R. A., O’Regan, J. K., Clark, J. J. To see or not to see: The need for attention to perceive changes in scenes. Psychological Science. 8 (5), 368-373 (1997).

- Tünnermann, J., Krüger, N., Mertsching, B., Mustafa, W. Affordance estimation enhances artificial visual attention: Evidence from a change-blindness study. Cognitive Computation. 7 (5), 525-538 (2015).

- Shore, D. I., Klein, R. M. The effects of scene inversion on change blindness. The Journal of General Psychology. 127 (1), 27-43 (2000).

- Scharlau, I., Neumann, O. Temporal parameters and time course of perceptual latency priming. Acta Psychologica. 113 (2), 185-203 (2003).

- Schneider, K. A., Bavelier, D. Components of visual prior entry. Cognitive Psychology. 47 (4), 333-366 (2003).

- Scharlau, I., Neumann, O. Perceptual latency priming by masked and unmasked stimuli: Evidence for an attentional interpretation. Psychological Research. 67 (3), 184-196 (2003).

- Shore, D. I., Spence, C., Klein, R. M. Visual prior entry. Psychological Science. 12 (3), 205-212 (2001).

- Alcalá-Quintana, R., García-Pérez, M. A. Fitting model-based psychometric functions to simultaneity and temporal-order judgment data: MATLAB and R routines. Behavior Research Methods. 45 (4), 972-998 (2013).

- Hoffman, M. D., Gelman, A. The No-U-turn sampler: adaptively setting path lengths in Hamiltonian Monte Carlo. Journal of Machine Learning Research. 15 (1), 1593-1623 (2014).

- Lee, M. D., Wagenmakers, E. J. . Bayesian cognitive modeling: A practical course. , (2014).

- Vangkilde, S., Bundesen, C., Coull, J. T. Prompt but inefficient: Nicotine differentially modulates discrete components of attention. Psychopharmacology. 218 (4), 667-680 (2011).

- Tünnermann, J., Scharlau, I. Peripheral Visual Cues: Their Fate in Processing and Effects on Attention and Temporal-order. Front. Psychol. 7 (1442), (2016).